Qu'est-ce que Computer Use ?

Computer Use est une capacité émergente des modèles d'IA multimodaux qui leur permet d'interagir avec des interfaces graphiques — exactement comme un humain le ferait. Au lieu de communiquer via des APIs ou des commandes textuelles, le modèle regarde un screenshot de l'écran, comprend ce qu'il voit, et décide quelle action effectuer : cliquer sur un bouton, taper du texte dans un champ, faire défiler la page, naviguer vers une URL.

Google DeepMind a intégré cette capacité dans Gemini 2.5, créant un modèle capable non seulement de comprendre du texte et des images, mais aussi d'agir dans le monde numérique. C'est un changement de paradigme : l'IA passe de l'assistant conversationnel à l'agent d'exécution.

Comment fonctionne Gemini Computer Use : l'architecture technique

L'architecture de Computer Use repose sur une boucle perception-décision-action qui se répète à chaque étape de la tâche :

1. Capture : le screenshot comme input

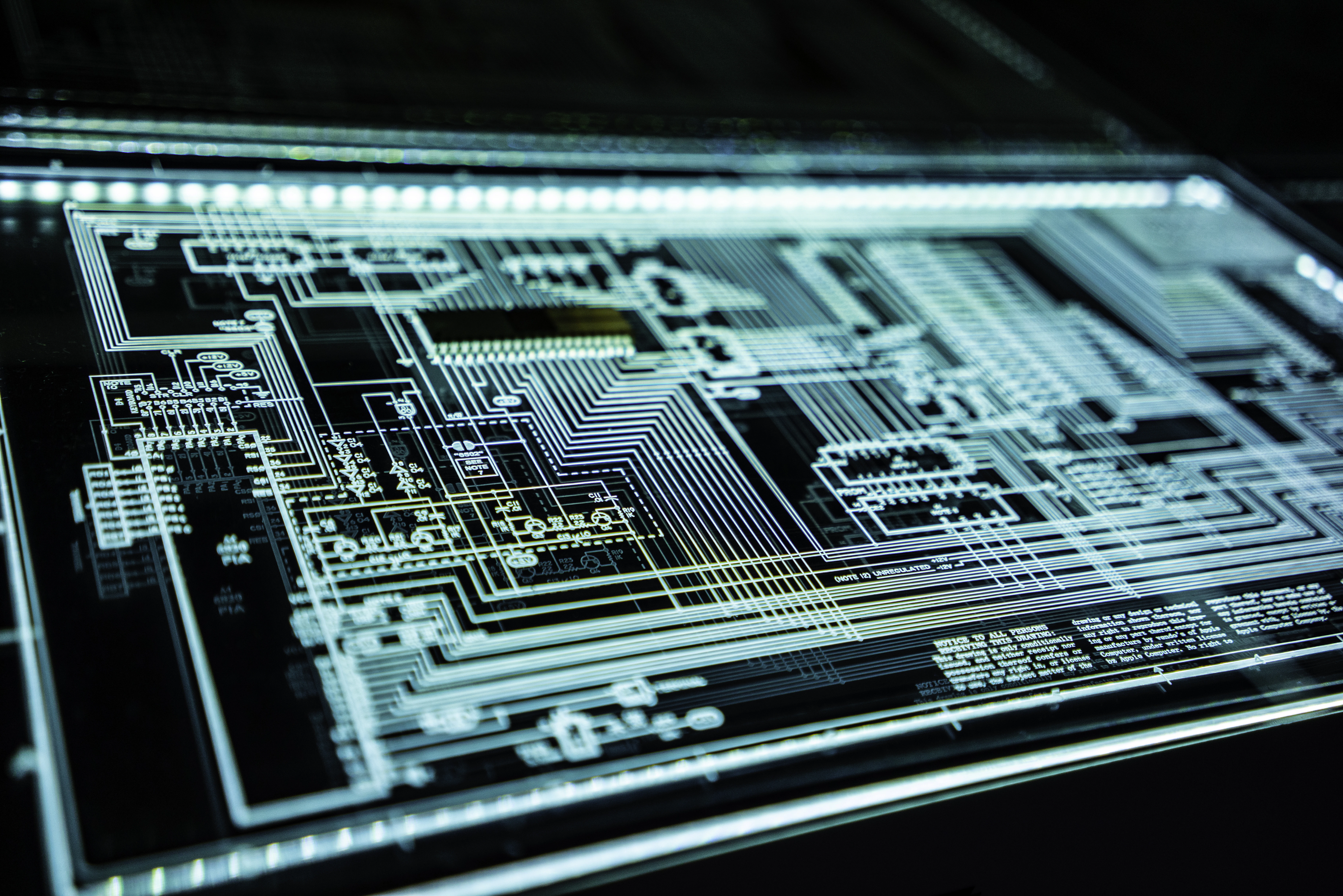

Le système capture un screenshot de l'écran courant du navigateur (ou du desktop). Ce screenshot est l'unique source d'information visuelle du modèle. Il ne lit pas le DOM HTML, n'analyse pas le code source et n'a pas accès aux sélecteurs CSS. Il voit la page exactement comme un utilisateur humain la verrait — pixels bruts, texte rendu, icônes et mise en page.

Cette approche est fondamentalement différente du scraping ou du RPA classique. Elle rend l'IA indépendante de la structure technique sous-jacente de la page. Que le site utilise React, Vue, Angular, du HTML statique ou une iframe imbriquée — peu importe. L'IA voit le résultat visuel final.

2. Analyse : comprendre ce que l'on voit

Gemini 2.5 analyse le screenshot et produit une représentation structurée de l'interface :

- Détection des éléments interactifs : boutons, liens, champs de saisie, cases à cocher, menus déroulants, onglets, icônes cliquables

- Lecture du texte : OCR natif qui lit tout le texte visible, y compris dans les images, les captures et les éléments stylisés

- Compréhension contextuelle : le modèle comprend le rôle de chaque élément dans le contexte de la page. Un bouton bleu avec le texte « Envoyer » en bas d'un formulaire est identifié comme le bouton de soumission, pas comme un simple rectangle coloré

- État de la page : le modèle détecte les états (chargement en cours, message d'erreur affiché, pop-up ouvert, champ en erreur) et adapte son comportement

3. Décision : planifier l'action suivante

Sur la base de l'analyse visuelle et de l'instruction utilisateur, le modèle décide de l'action suivante. Les actions possibles sont :

- click(x, y) : cliquer à des coordonnées précises sur l'écran

- type(text) : saisir du texte dans le champ actuellement focalisé

- scroll(direction, amount) : faire défiler la page

- navigate(url) : naviguer vers une URL

- key(combination) : appuyer sur une combinaison de touches (Ctrl+C, Tab, Enter)

- wait() : attendre que la page finisse de charger

Le modèle ne choisit pas seulement l'action immédiate — il maintient un plan d'exécution pour la tâche complète. S'il doit remplir un formulaire de 5 champs, il planifie la séquence complète : focus sur le premier champ, saisie, tab vers le suivant, saisie, etc. Et il adapte ce plan en temps réel si quelque chose d'inattendu se produit.

4. Exécution et feedback

L'action est exécutée dans le navigateur (via l'extension Chrome ou l'application Electron), puis un nouveau screenshot est capturé pour vérifier le résultat. Le modèle compare l'état attendu avec l'état observé :

- Le champ a bien été rempli ? Le texte affiché correspond à ce qui a été saisi ?

- Le clic a produit l'effet attendu ? La page a navigué vers la bonne destination ?

- Un message d'erreur est apparu ? Un pop-up inattendu bloque l'interface ?

Si l'état observé ne correspond pas à l'état attendu, le modèle ajuste son plan et tente une action corrective. C'est cette boucle de feedback qui rend l'automatisation robuste face aux imprévus.

Ce que Gemini Computer Use fait mieux que les alternatives

Résistance aux changements d'interface

C'est l'avantage killer. Un bot RPA qui cible #submit-button-v2 casse quand l'identifiant change en #btn-submit-new. Gemini Computer Use identifie toujours le bouton de soumission, parce qu'il comprend visuellement son rôle — couleur primaire, position en bas du formulaire, texte « Envoyer » ou « Soumettre ». Le code HTML en dessous est totalement transparent.

Gestion des SPA et du contenu dynamique

Les applications web modernes génèrent leur contenu dynamiquement via JavaScript. Les identifiants HTML changent à chaque rendu, les composants sont montés et démontés à la volée. Pour un sélecteur CSS, c'est un cauchemar. Pour un modèle qui regarde le screenshot, c'est invisible — il voit le résultat final rendu, pas le processus de rendu.

Compréhension multilingue native

Gemini 2.5 comprend le texte dans plus de 100 langues. Un bouton « Envoyer », « Send », « Enviar » ou « Senden » est reconnu de la même façon. C'est un avantage décisif pour les entreprises internationales qui utilisent des outils dans plusieurs langues.

Les limites actuelles de Computer Use

La technologie est puissante mais pas parfaite. Voici les limites qu'il faut connaître :

Latence

Chaque cycle capture-analyse-décision-exécution prend entre 1 et 3 secondes selon la complexité de la page. Pour un workflow de 20 étapes, comptez 30 à 60 secondes d'exécution. C'est beaucoup plus rapide qu'un humain, mais plus lent qu'un appel API direct. Pour les tâches à très haute fréquence (milliers d'exécutions par heure), l'API reste plus efficace.

Précision du clic

Sur les interfaces très denses avec des éléments rapprochés (tableaux à colonnes étroites, menus déroulants imbriqués), la précision du clic peut être insuffisante. Le modèle cible parfois l'élément adjacent. Les systèmes modernes intègrent un mécanisme de retry : si le résultat du clic ne correspond pas à l'attendu, le modèle réessaie avec des coordonnées ajustées.

Contenu hors écran

Le modèle ne voit que ce qui est affiché dans le screenshot courant. Le contenu en dessous du pli (accessible par scroll) ou dans des onglets non sélectionnés est invisible tant que l'IA n'a pas scrollé ou navigué. Les workflows doivent inclure des étapes de scroll explicites pour accéder au contenu complet.

Actions système

L'extension navigateur est limitée au contexte du navigateur. Les interactions avec le système d'exploitation (gestion de fichiers, notifications, applications desktop) nécessitent la version desktop Electron. C'est une distinction importante pour les workflows qui impliquent des transferts de fichiers ou des interactions avec des logiciels installés.

L'avenir de Computer Use : agent IA autonome

Computer Use est aujourd'hui à ses débuts. Les évolutions attendues dans les 12 à 18 prochains mois sont significatives :

- Agents autonomes : des workflows complexes exécutés de bout en bout sans intervention humaine, avec des points de contrôle configurables

- Apprentissage par démonstration : montrez à l'IA comment vous faites une tâche, et elle la reproduit automatiquement les fois suivantes

- Collaboration multi-agents : plusieurs agents IA travaillant en parallèle sur des sous-tâches d'un même workflow

- Intégration mobile : Computer Use étendu aux interfaces mobiles (iOS, Android) pour automatiser les tâches sur smartphone

Gemini Computer Use transforme le navigateur d'un outil passif — où l'humain clique et tape — en un environnement où l'IA peut agir de façon autonome sous supervision humaine. Ce n'est pas de la science-fiction : c'est une technologie opérationnelle en production, qui s'améliore à chaque itération du modèle. Les 28 % de temps en tâches répétitives n'ont plus de raison d'exister.

Gemini Computer Use est-il disponible publiquement ?+

Quelle est la différence entre Gemini Computer Use et Claude Computer Use ?+

L'IA peut-elle apprendre de mes habitudes pour s'améliorer ?+

Aller plus loin

Plongée technique dans Gemini 2.5 Computer Use de Google DeepMind : comment le modèle analyse des screenshots, identifie...